关注算法安全新兴领域,清华团队RealAI推出业界首个AI模型“杀毒软件”

近日,清华大学AI研究院孵化企业RealAI(瑞莱智慧)正式推出首个针对AI在极端和对抗环境下的算法安全性检测与加固的工具平台——RealSafe人工智能安全平台。该平台内置领先的AI对抗攻防算法,提供从安全测评到防御加固整体解决方案,目前可用于发现包括人脸比对等在内的常用AI算法可能出错的极端情形,也能预防潜在的对抗攻击。

业界首个针对AI在极端和对抗环境下的算法安全性检测与加固的工具平台

“对抗样本”成新型病毒,算法安全问题亟待解决

随着人工智能技术的高速发展,人工智能在诸多场景正逐渐替代或协作着人类的各种劳动,它们可以成为人类的眼睛、耳朵、手臂甚至大脑。

其中,机器视觉作为AI时代的基础技术,其背后的AI算法一直是各科技巨头和创业公司共同追逐的热点。然而在机器视觉诸多主流应用场景的背后,往往也藏着由技术性缺陷导致的算法安全风险。

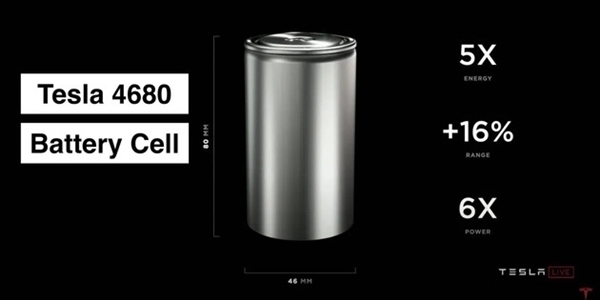

例如,在一些训练数据无法覆盖到的极端场景中,自动驾驶汽车的识别系统可能出现匪夷所思的决策,危害乘车人的人身安全。从2016年至今,Tesla、Uber等企业的辅助驾驶和自动驾驶系统就都曾出现过类似致人死亡的严重事故。并且这类极端情形也可能被恶意制造并利用,发动“对抗样本攻击”,去年7月,百度等研究机构就曾经通过3D技术打印出能让自动驾驶“无视”的障碍物,让车辆面临撞击风险。

而以上攻击之所以能成功,主要是机器视觉和人类视觉有着很大的差异。因此可以通过在图像、物体等输入信息上添加微小的扰动改变(即上述故意干扰的“对抗样本”),就能导致很大的算法误差。此外,随着AI的进一步发展,AI算法模型将运用金融决策、医疗诊断等关键核心场景,这类AI“漏洞”的威胁将愈发凸显出来。

近年来,包括清华大学人工智能研究院院长张钹院士、前微软全球执行副总裁沈向洋等均提倡要发展安全、可靠、可信的人工智能以及负责任的人工智能,其中AI的安全应用均是重点方向。

而且,AI安全作为新兴领域,在开源社区、工具包的加持下,对抗样本等攻击手段日益变得复杂,相关防御手段的普及和推广却难以跟上。并且对抗样本等算法漏洞检测存在较高的技术壁垒,目前市面上缺乏自动化检测工具,而大部分企业与组织不具备该领域的专业技能来妥善应对日益增长的恶意攻击。

从安全测评到防御加固,RealSafe让AI更加安全可控

就如网络安全时代,网络攻击的大规模渗透诞生出杀毒软件,RealAI团队希望通过RealSafe平台打造出人工智能时代的“杀毒软件”,帮助企业高效应对人工智能时代下算法漏洞孕育出的“新型病毒”。

目前,RealSafe平台主要支持两大功能模块:模型安全测评、防御解决方案。

其中,模型安全评测主要为用户提供AI模型安全性评测服务。用户只需接入所需测评模型的SDK或API接口,选择平台内置或者自行上传的数据集,平台将基于多种算法生成对抗样本模拟攻击,并综合在不同算法、迭代次数、扰动量大小的攻击下模型效果的变化,给出模型安全评分及详细的测评报告(如下图)。目前已支持黑盒查询攻击方法与黑盒迁移攻击方法。

防御解决方案则是为用户提供模型安全性升级服务,目前RealSafe平台支持五种去除对抗噪声的通用防御方法,可实现对输入数据的自动去噪处理,破坏攻击者恶意添加的对抗噪声。根据上述的模型安全评测结果,用户可自行选择合适的防御方案,一键提升模型安全性。另外防御效果上,根据实测来看,部分第三方的人脸比对API通过使用RealSafe平台的防御方案加固后,安全性可提高40%以上

随着模型攻击手段在不断复杂扩张的情况下,RealSafe平台还持续提供广泛且深入的AI防御手段,帮助用户获得实时且自动化的漏洞检测和修复能力。

准确度99.99%也难逃被“恶意干扰”,RealSafe高效应对算法威胁

考虑到公众对于对抗样本这一概念可能比较模糊,RealSafe平台特意选取了公众最为熟知的人脸比对场景(人脸比对被广泛用于金融远程开户、刷脸支付、酒店入住登记等场景的身份认证环节)提供在线体验。

并且,为了深入研究“对抗样本”对人脸比对系统识别效果的影响,RealAI 团队基于此功能在国内外主流 AI 平台的演示服务中进行了测试。

实测证明,“对抗样本”可以极大的干扰人脸比对系统的识别结果,而测试的这几家互联网公司平台开放的人脸比对API或SDK,几乎覆盖了目前市面上很多中小型企业在落地人脸识别应用时的选择,如果他们的人脸比对技术存在明显的安全漏洞,意味着更广泛的应用场景将存在安全隐患。

因此,为了帮助更大范围内的企业高效应对算法威胁,RealSafe平台具备以下两大优势:

·组件化、零编码的在线测评:相较于ART、Foolbox等开源工具需要自行部署、编写代码,RealSafe平台采用组件化、零编码的功能设置,免去了重复造轮子的精力与时间消耗,用户只需提供相应的数据即可在线完成评估,学习成本低,无需拥有专业算法能力也可以上手操作。

·可视化、可量化的评测结果:为了帮助用户提高对模型安全性的概念,RealSafe平台采用可量化的形式对安全评测结果进行展示,根据模型在对抗样本攻击下的表现进行评分,评分越高则模型安全性越高。此外,RealSafe平台提供安全性变化展示,经过防御处理后的安全评分变化以及模型效果变化一目了然。

从数字世界到物理世界 RealAI落地更多安全周边产品

随着机器学习模型不断的升级演化,“对抗样本”已经演变成一种新型攻击手段,并且逐渐从数字世界蔓延到物理世界:在路面上粘贴对抗样本贴纸模仿合并条带误导自动驾驶汽车拐进逆行车道、胸前张贴一张对抗样本贴纸在监控设备下实现隐身……

因此,除了针对数字世界的算法模型推出安全评测平台,RealAI团队也联合清华大学AI研究院围绕多年来积累的领先世界的研究成果落地了一系列AI攻防安全产品,为更多场景保驾护航。

比如通过佩戴带有对抗样本图案的“眼镜”,黑客可以轻易破解商用手机的面部解锁,通过在胸前张贴特制花纹实现在AI监控下的“隐身”,以及通过在车辆上涂装特殊花纹躲避AI对车辆的检测。发现类似新型漏洞的同时,RealAI也推出相应的防御技术,支持对主流AI算法中的安全漏洞进行检测,并提供AI安全防火墙对攻击AI模型的行为进行有效拦截。

人工智能的大潮滚滚而来,随之而来的安全风险也将越来越多样化,尤其近年来因AI技术不成熟导致的侵害风险也频频发生,可以说,算法漏洞已逐渐成为继网络安全、数据安全后又一大安全难题。

所幸的是,以RealAI为代表的这些顶尖AI团队早已开始了AI安全领域的征程,并开始以标准化的产品助力行业降低应对安全风险的门槛与成本。此次上线RealSafe人工智能安全平台是RealAI的一小步尝试,但对于整个行业而言,这将是人工智能产业迈向健康可控发展之路的一大步。